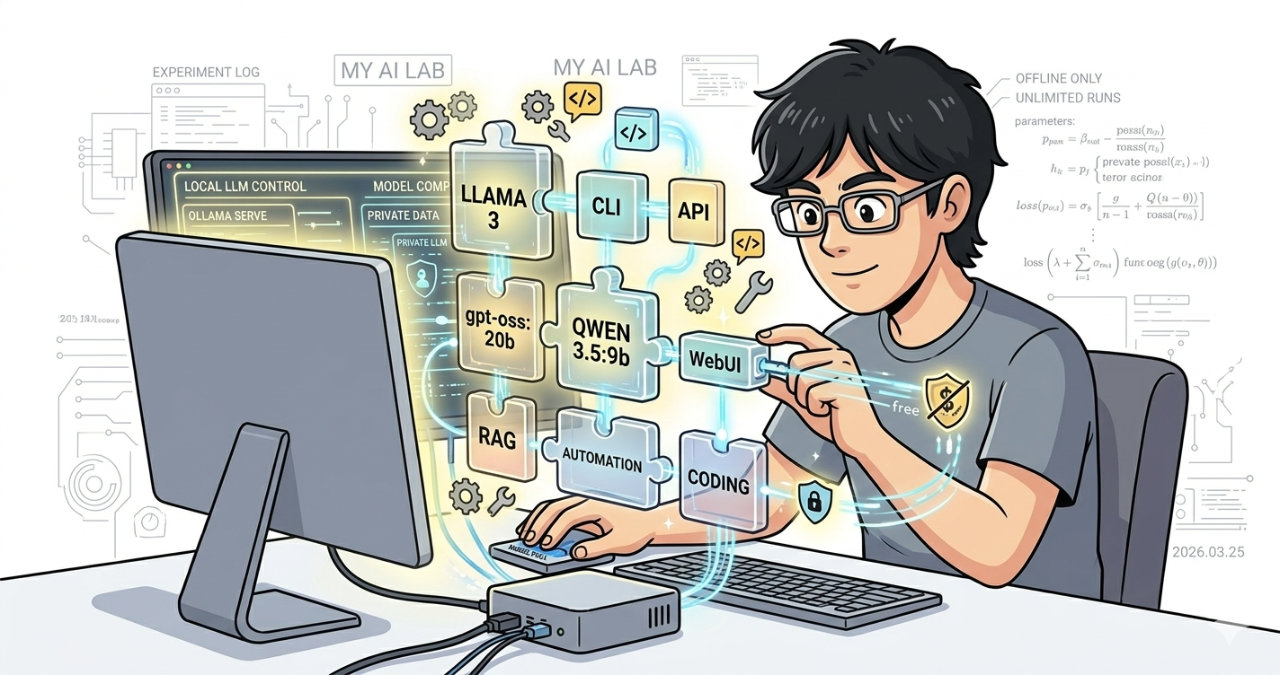

ローカル環境で AI を動かす、という選択肢が現実的になってきました。

これまでは ChatGPT のように、クラウド上の AI を Webブラウザ等の GUI や API 経由で使うのが一般的でしたが、最近では自分の PC で AI を動かす環境も整ってきています。

ローカルLLM を動かす方法はいくつかあり、

- Ollama

- LM Studio

- llama.cpp

といったツールが代表的です。

それぞれに特徴があり、用途によって選び方も変わります。

その中でこのサイトでは、「Ollama」を中心に検証していきます。

理由はシンプルで、

- 導入が比較的簡単

- モデル管理がしやすい

- 外部ツールとの連携がしやすい

という点で、「実験環境」として扱いやすいからです。

この記事では、実際に Ollama を触りながら、

- 何ができるのか

- どうやって導入するのか

- どのモデルを選べばいいのか

といったポイントを、実験ログとしてまとめていきます。

- API 課金をせずに、無料で AI を使いたい

- ローカルで完結させたい

そんな人の最初の入口になればと思います。

Ollama とは何か

Ollama(オラマ)は、ローカル環境で大規模言語モデル(LLM)を動かすためのツールです。

これまで ChatGPT のような AI は、Webブラウザ等の GUI やAPI 経由でクラウド上のモデルを使うのが一般的でした。

しかし Ollama を使うことで、インターネット接続や API 課金に依存せず、自分の PC だけで AI を動かすことができます。

いわば「AI をローカルに持ってくるための実行環境」です。

仕組みとしてはシンプルで、モデル( Llama や Qwen など)をダウンロードし、それを Ollama 経由で実行するだけです。

ターミナルからコマンドを1つ打つだけで、AI との対話が始まります。

最初は少しとっつきにくく感じますが、一度動かしてしまえば「思ったより普通に使える」というのが正直な感想です。

この “普通に使える” という感覚が、ローカルLLM を実用レベルに引き上げているポイントだと思っています。

なぜ Ollama を使うのか

Ollama を使う理由はシンプルで、「無料で、制限なく、AI を使いたいから」です。

クラウド AI(API)は非常に便利ですが、使えば使うほどコストが積み上がります。

ちょっとした検証や試行錯誤をするたびに課金を気にするのは、実験環境としてはかなりストレスになります。

一方で Ollama は、最初に環境さえ整えてしまえば、あとは基本的に無料です(電気代やパソコン代は必要です)。

特に Mac mini のような省電力なマシンでも、軽量モデルを選べば十分に実用的な速度で動きます。

もちろん、クラウド AI に比べれば性能は劣る部分もあります。

ただしそれ以上に、

- オフラインで動く

- データを外に出さない

- 好きなだけ試せる

という自由度の高さが魅力です。

ここまでを見ると、「ローカルで動くなら安心」「無料なら自由に使える」と感じるかもしれません。

ただし、この認識は半分正解で、半分は注意が必要です。

実際には、

- 本当にデータは外に出ないのか

- モデルごとに商用利用できるのか

といった前提を理解していないと、思わぬリスクにつながる可能性があります。

このあたりは見落とされやすい重要ポイントなので、別記事で整理しています。

このサイトでは、無料で AI を使う というカテゴリを軸にしていますが、Ollama はその中心的な存在になります。

高性能な AI を “使う” だけでなく、「どう動かすか」「どう組み合わせるか」を試す。

そういう意味で、Ollama は単なるツールではなく、AI 実験のための土台だと考えています。

Ollama の導入方法

Ollama の導入自体は、思っているよりシンプルです。

ただし、OS ごとに手順が異なるため、ここでは「全体の流れ」だけを押さえておきます。

基本の流れは共通で、

- Ollama をインストール

- 起動できるか確認

- モデルをダウンロード

- 実際に動かす

という4ステップです。

OS ごとの違いについて

Ollama は、Mac / Windows / Linux に対応しています。

それぞれで導入方法が少しずつ異なりますが、基本的には「公式サイトの手順を実行するだけ」で導入できます。

このサイトでは、実際の検証環境として Mac(Apple Silicon)を中心に解説していきます。

インストール後の確認

インストールが完了したら、ターミナルまたはアプリでモデルを実行します。

初回はモデルのダウンロードが始まり、完了するとそのままチャットができる状態になります。

ここまで来れば、ローカルLLM の環境は一通り整った状態です。

詳しい手順はこちら

OS ごとの具体的な手順は、以下の記事にまとめています。

まずは自分の環境に合わせて、一度「動かす」ことを目標に進めてみてください。

Ollama の基本の使い方

Ollama の導入が終わったら、次は実際に AI を動かしてみます。

ここでは難しいことはせず、「とりあえず1回使ってみる」ことをゴールにします。

モデルをダウンロードして実行する

Ollama では、モデルを指定して実行するだけで、自動的にダウンロードと起動が行われます。

例えば、以下のコマンドを実行します。

ollama run llama3初回はモデルのダウンロードが始まり、数分〜数十分ほど待つと、そのままチャット画面に入ります。

なお、モデルは事前にダウンロードしておくことも可能です。

その場合は pull コマンドを使用します。

AI と会話してみる

ダウンロードが完了すると、そのままターミナル上で AI との対話が始まります。

試しにこんな感じで入力してみます。

こんにちは。簡単に自己紹介してください。すると、AI からの返答が返ってきます。

この時点で、「ローカルで AI が動いている」状態が完成しています。

よく使う基本コマンド

Ollama はシンプルなコマンドで操作できます。

よく使うものだけ押さえておけば十分です。

#モデルの起動&チャットの開始

ollama run

#モデル一覧を見る

ollama list

#モデルをダウンロード

ollama pull モデル名

#モデルを削除

ollama rm モデル名

#サーバーとして起動

ollama serveそれぞれのコマンドの役割や使いどころについては、以下でまとめています。

まずは「run」と「list」だけ覚えておけば OK です。

モデルを変えてみる

慣れてきたら、別のモデルも試してみます。

例えば

ollama run qwen3.5:9bollama run gpt-oss:20bモデルによって、

- 回答の雰囲気

- 日本語の自然さ

- 処理速度

がかなり変わるので、ここは実際に触って違いを体感するのが一番です。

最初のゴール

ここまでで、

- Ollama が動いた

- AI と会話できた

- モデルを切り替えられた

という状態になっていれば OK です。

この「一度動いた」という体験ができれば、あとは用途に応じて広げていくだけです。

ここまでで、Ollamaの基本的な流れは一通り体験できています。

今回使ったコマンドやモデルの扱いについては、それぞれ個別の記事で詳しく整理しています。

次は、どのモデルを選ぶべきかを整理していきます。

モデル選びの考え方

Ollama を触り始めて最初に迷うのが、「どのモデルを使えばいいのか」という問題です。

結論から言うと、正解は1つではなく、「実際に使われているモデル」と「自分の環境」で決めるのが近道です。

モデルとは何か

Ollama 本体はあくまで “実行環境” で、実際に AI として動くのは「モデル」です。

代表的なものだと

- Llama 系

- Qwen 系

- Mistral 系

- DeepSeek 系

- Gemma 系

などがあり、それぞれに特徴があります。

同じ質問をしても、モデルによって返ってくる答えはかなり変わります。

まずは “定番モデル” を触る

最初におすすめなのは、スペックに合わせて軽くすることではなく、まず「実際に使われているモデル」を触ることです。

例えば

🧠 gpt-oss:20b(容量:14GB)

2025年8月にリリースされたモデル。バランスがよく安定しているがやや重い。

🧠 qwen3.5:9b(容量:6.6GB)

2026年3月にリリースされたモデル。軽くて性能が高い。

このあたりは、記事更新日時点でもよく使われているモデルです。

まずはこの2つを触るだけでも、ローカルLLM の感覚はかなり掴めます。

モデルサイズと現実的なライン

もちろんモデルサイズも重要です。

- 20Bクラス → ある程度の性能と実用性

- 9Bクラス → 軽さと性能のバランス

Mac mini M4(32GB メモリ)の環境では、このあたりが現実的なラインになります。

無理に巨大モデルを狙うよりも、「ちゃんと使えるサイズ」を選ぶ方が重要です。

日本語性能について

日本語で使う場合は、モデルによってかなり差が出ます。

現時点では、Qwen 系は日本語でもかなり自然に使える印象があります。

このあたりはスペックだけでは判断できないので、実際に触って確かめるのが一番です。

用途で使い分ける

ある程度触ってくると、

- 会話用

- 文章生成用

- コーディング用

といった形で、モデルを用途ごとに分ける方が効率的になります。

最初から完璧に選ぼうとせず、「試して入れ替える」くらいの感覚で OK です。

おすすめモデル(用途別)

ここでは、「どのモデルを使えばいいか」で迷わないための方向性だけを整理します。

前提として、モデルの性能や適性は一概には決められません。

- ツール(CLI / Claude Code / n8n など)

- プロンプト(指示の出し方)

- 実行環境(メモリ / GPU)

によって、同じモデルでも挙動が変わるためです。

そのため、このセクションでは「具体的なおすすめ」を断定するのではなく、

- 最初にどう選ぶか

- どの方向で試すか

という観点でまとめています。

まず試すならこの考え方

最初の段階では、「最適なモデルを選ぶ」よりも、

- 実際に使われているモデルを触る

- 重さの違いを体感する

という方が重要です。

例えば、

- 20Bクラス(しっかり回答するがやや重い)

- 9Bクラス(軽さと性能のバランス)

といった違いを試すだけでも、ローカルLLM の感覚はかなり掴めます。

モデルサイズと現実的なライン

ローカルLLM では、モデルサイズがそのまま使い勝手に直結します。

目安としては、

- 20B〜30Bクラス → 精度重視

- 7B〜9Bクラス → 日常使い

- 〜7Bクラス → 速度重視

といった使い分けが現実的です。

無理に大きなモデルを使うよりも、「快適に動く範囲」で選ぶ方が結果的に使い続けやすくなります。

日本語で使う場合

日本語性能はモデルごとの差が出やすいポイントです。

ただし、

- プロンプトの書き方

- 会話の流れ

- モデルのバージョン

によっても結果は変わるため、スペックだけで判断するのは難しいです。

実際にいくつか試して比較するのが確実です。

用途で使い分ける

ある程度触ってくると、

- 会話用

- 文章生成用

- コーディング用

- OCR や特化用途

といった形で、モデルを用途ごとに分ける方が効率的になります。

Ollama はモデルの切り替えが簡単なので、「1つに絞る」よりも「用途で分ける」前提の方が扱いやすくなります。

実際に使っているモデルについて

ここまで読んで、「結局どのモデルを使えばいいのか?」と感じた場合は、実際に使っているモデルをまとめた記事を参考にしてください。

Mac mini M4(32GB)環境で、

- 普段使いでよく触っているモデル

- 実際に試して残ったモデル

- 用途ごとの使い分け

をまとめています。

※いわゆるランキングではなく、実際に使って残ったモデルだけを整理しています。

Ollama の使い方( CLI・アプリ・WebUI )

Ollama はターミナルで使うイメージが強いですが、実際にはいくつかの使い方があります。

ここでは、用途に応じた使い分けを整理しておきます。

① Ollama アプリで使う(最も簡単)

まず一番手軽なのが、Ollama のデスクトップアプリです。

インストールするだけで、すぐに AI とのチャットができる環境が整います。

「とりあえず触ってみたい」という場合は、この方法だけでも十分です。

ただし、機能はシンプルなので、カスタマイズや連携にはあまり向いていません。

② CLI で使う(基本操作)

次に、ターミナルで直接操作する方法です。

ollama run

ollama pullといったコマンドで、モデルの実行や管理ができます。

この方法はシンプルで軽く、仕組みを理解するには最適です。

ただし、実運用としてはこれ単体で使い続けるケースはあまり多くありません。

③ WebUI で使う(操作性アップ)

もう一つの選択肢が、WebUI です。

Open WebUI などのツールを使うことで、ブラウザ上でチャットできるようになり、履歴管理やモデル切り替え、詳細な設定も行えるようになります。

ただし、Docker などの知識が必要になるため、少しだけハードルは上がります。

④ 外部ツールと連携して使う(本命)

実際に Ollama を活用していく場合、他のツールと組み合わせることが多くなります。

例えば

- n8n(自動化)

- Claude Code(コーディング支援)

- 各種エディタ連携

このように、Ollama を「AIエンジン」として使うイメージです。

この段階に入ると、単なるチャットツールではなく、作業の一部として組み込めるようになります。

Ollama でできること(応用・連携)

ここまでで Ollama の基本は一通り触れましたが、実際に価値が出てくるのはここからです。

Ollama は単体で使うよりも、他のツールと組み合わせることで一気に可能性が広がります。

AI チャットとして使う

まずはシンプルに、ローカル環境の AI チャットとして使えます。

- 文章の作成

- アイデア出し

- 調べ物の補助

など、普段 ChatGPT でやっていることはそのまま置き換えることができます。

しかもローカル環境なので、データを外に出さずに使えるのが大きなメリットです。

コーディング支援として使う

Ollama はコーディング用途とも相性が良いです。

- コード生成

- エラーの修正

- 処理の説明

など、開発中のサポートとして使えます。

Claude Code のようなツールと組み合わせることで、ローカル環境でもかなり実用的な開発支援が可能になります。

自動化ツールと連携する

n8n などの自動化ツールと組み合わせると、Ollama を “処理エンジン” として使うことができます。

例えば

- 入力されたテキストを要約する

- 特定の条件で文章を生成する

- データを整形する

といった処理を、ワークフローの中に組み込めます。

これにより、単発のチャットではなく「仕組み」として AI を使えるようになります。

RAG(ナレッジ活用)

ローカルファイルや独自データを使って、AI に回答させることもできます。

いわゆる RAG(検索拡張生成)と呼ばれる使い方です。

- ドキュメント検索

- 社内ナレッジ活用

- メモの整理

など、自分専用の AI として使えるようになります。

画像・マルチモーダル

モデルによっては、

- 画像の解析

- 画像生成

といったマルチモーダルな使い方も可能です。

ただし、このあたりはモデル依存が大きく、環境によって難易度も変わります。

今後の検証対象の一つです。

「 AI を部品として使う」という考え方

重要なのは、Ollama を単体ツールとして見るのではなく、

「 AI をローカルで動かすための部品」

として考えることです。

- エディタとつなぐ

- 自動化に組み込む

- ツール同士をつなぐ

この発想に切り替えると、できることが一気に広がります。

よくある問題と対策

Ollama はシンプルに見えて、実際に使っていくといくつかハマりやすいポイントがあります。

ここでは、よくあるトラブルとその対処方法をまとめておきます。

モデルのダウンロードが遅い / 進まない

モデルは数GB単位のサイズになるため、ダウンロードに時間がかかることがあります。

また、回線や時間帯によっては途中で止まったように見えることもあります。

対処方法

- 時間を置いて再実行する

- 安定した回線でダウンロードする

- 必要なモデルだけに絞る

特に最初は、複数モデルを一気に入れないのがおすすめです。

動作が重い / 反応が遅い

ローカルLLM はマシン性能の影響を強く受けます。

動作が重い場合は、モデルサイズが合っていない可能性があります。

対処方法

- 軽量モデルに切り替える

- 同時に動かしているアプリを減らす

- メモリ使用量を確認する

Mac mini M4(32GB メモリ)でも、モデルによっては重さを感じることがあります。

メモリ不足になる

モデル実行時にメモリを大きく消費するため、環境によっては不足することがあります。

対処方法:

- 小さいモデルを選ぶ

- 他のアプリを終了する

- 一度 Ollama を再起動する

特にブラウザを大量に開いていると、影響が出やすいです。

モデルがうまく動かない

- 応答が返ってこない

- 途中で止まる

- エラーになる

といったケースもあります。

対処方法

- 別のモデルで試す

- 一度モデルを削除して再取得する

- Ollama 自体を再起動する

モデルごとに安定性が違うため、「合うモデルを探す」感覚も重要です。

日本語が不自然

モデルによっては、日本語が不自然になることがあります。

対処方法

- 日本語に強いモデルを選ぶ

- プロンプトを調整する

例えば、

「日本語で自然に回答してください」

と一文追加するだけでも改善することがあります。

ポートや接続の問題(連携時)

n8n やエディタと連携する際に、接続できないケースがあります。

対処方法

- Ollama が起動しているか確認

- ポート番号(通常11434)を確認

- ローカルアクセス制限をチェック

Docker 環境から接続している場合は、localhost では接続できないことがあります。

その場合は、

http://host.docker.internal:11434のように、ホスト側のアドレスを指定することで接続できるケースがあります。

特に n8n を Docker で動かしている場合は、この設定が必要になることが多いです。

「思ったより使えない」と感じる

これはトラブルというより、よくある “最初の壁” です。

ローカルLLM は、クラウド AI と比べると性能差があります。

ただし、

- 用途を絞る

- モデルを選ぶ

- 使い方を工夫する

ことで、実用レベルまで引き上げることは可能です。

まとめ 📝 Ollamaは「AIをローカルで使うための基盤」

ここまで、Ollama の導入から使い方、できることまで一通り見てきました。

改めて整理すると、Ollama は

「ローカル環境で AI を動かすための基盤」

という位置づけになります。

この記事のポイント

- Mac で ローカルLLM を動かせる

- モデルを選んで自由に試せる

- アプリ / CLI / WebUI など複数の使い方がある

- 他ツールと連携することで本領を発揮する

単体でも使えますが、真価が出るのは「組み合わせたとき」です。

最後に

ローカルLLM は、最初は「思ったより難しい」と感じるかもしれません。

ですが、

- 課金を気にしなくていい

- データを外に出さない

- 自分の環境で自由に試せる

という大きなメリットがあります。

この「実験室」では、その可能性を一つずつ検証していきます。

まずは一つ、モデルを動かしてみるところから始めてみてください。