Ollama を使う上で避けて通れないのが「モデルのダウンロード(インストール)」です。

ollama run でも自動的にモデルは取得されますが、実際に使っていくなら pull コマンドを理解しておく方が便利です。

この記事では、

- モデルのダウンロード方法

runとの違い- どのモデルを選べばいいか

を、実際の使い方ベースで解説します。

ollama pull とは何か

ollama pull は、モデルを事前にダウンロード(インストール)するためのコマンドです。

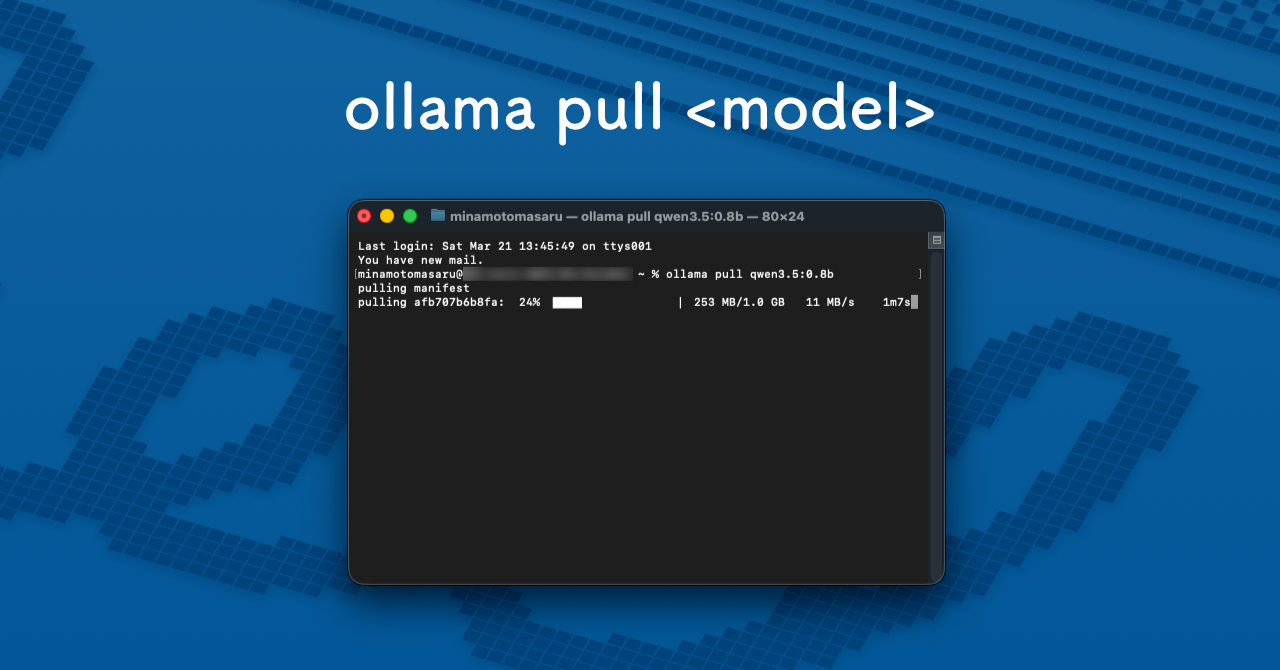

ollama pull モデル名これを実行することで、指定したモデルをローカル環境に保存できます。

run との違い

ollama run と pull の違いはシンプルです。

- run → ダウンロード+実行

- pull → ダウンロードのみ

run は手軽ですが、pull を使うと「事前にモデルを用意する」という使い方ができます。

実際にモデルをダウンロードする

まずは軽量モデルを試してみます。

ollama pull qwen3.5:0.8bこのモデルは比較的軽く、初めての環境でも試しやすいのが特徴です。

ダウンロードが始まり、進行状況が表示されます。

完了すると、ローカルに保存されます。

モデルサイズについて

モデルはサイズによって必要なリソースが大きく変わります。

目安としては、

- 0.5B 〜 4B → 軽量(試しやすい)

- 7B 〜 9B → バランス型

- 20B 以上 → 高性能だが重い

特に最初は、「軽くて動く」モデルを選ぶのがおすすめです。

重いモデルはあとからでも試せます。

モデルの保存場所について

ダウンロード(インストール)したモデルは、デフォルトでは以下の場所に保存されます。

~/.ollama/models実際のモデルデータは blobs フォルダ内に保存されます。

モデルサイズが大きくなると、数十GB 単位でストレージを消費することもあるため、保存場所は把握しておくのがおすすめです。

特に 20B 以上のモデルを複数入れ始めると、容量管理がかなり重要になります。

以前、モデルファイルの管理や保存場所について検証した内容は以下の記事にまとめています。

➡️ Ollama のモデルファイルが消える問題と保存場所ディレクトリの再検討ログ

どのモデルを選ぶべきか

最初の1つとしては、

qwen3.5:0.8b

qwen3.5:2b

qwen3.5:4bがおすすめです。

理由は、

- ダウンロードが速い

- メモリ消費が少ない

- とりあえず動かせる

という点です。

その後、

qwen3.5:9b

gemma4:e4b

gpt-oss:20b

gemma4:26b

qwen3.5:35b-a3b-coding-nvfp4といったモデルに広げていくと、違いが分かりやすくなります。

モデル一覧の確認方法

どのモデルが使えるのかは、公式サイトで一覧を確認できます。

ここでは、

- モデルの種類

- サイズ

- 特徴

などを一覧でチェックできます。

気になるモデルを見つけたら、そのまま ollama pull でダウンロードできます。

最初は迷うと思いますが、いくつか試してみるのが一番早いです。

※実際にはモデルごとにクセや得意分野があるため、一覧だけで判断するのは難しいです。

このサイトでは、実際に触ったモデルの使用感もまとめています。

➡️ Ollama おすすめモデル(Mac mini M4(32GB)で実際に使っているモデルまとめ)

よくあるつまずき

・ダウンロードが遅い

→ モデルサイズが大きいため時間がかかる

・途中で止まる

→ 再度 pull を実行する

・容量が足りない

→ ストレージを確認する

・どこに保存されているかわからない

→ デフォルトでは ~/.ollama に保存される

次にやること

モデルをダウンロードしたら、次は実際に使ってみます。

ollama run qwen3.5:0.8bすでにダウンロード済みなので、すぐに起動します。

次のステップとしては、

- モデルを切り替えて試す

- よく使うコマンドを覚える

- 用途に合わせてモデルを選ぶ

あたりがおすすめです。

まとめ

ollama pull を使うことで、モデルを事前にダウンロード(インストール)できます。

- モデル管理がしやすくなる

- 複数モデルを使い分けやすい

- ダウンロードと実行を分けられる

まずは軽量モデルから試し、徐々に自分の環境に合うモデルを見つけていくのがポイントです。