Ollama は、ローカル環境で AI を動かせるツールとして広く知られていますが、クラウド上でモデルを実行する機能も提供されています。

実際に使い始めると、

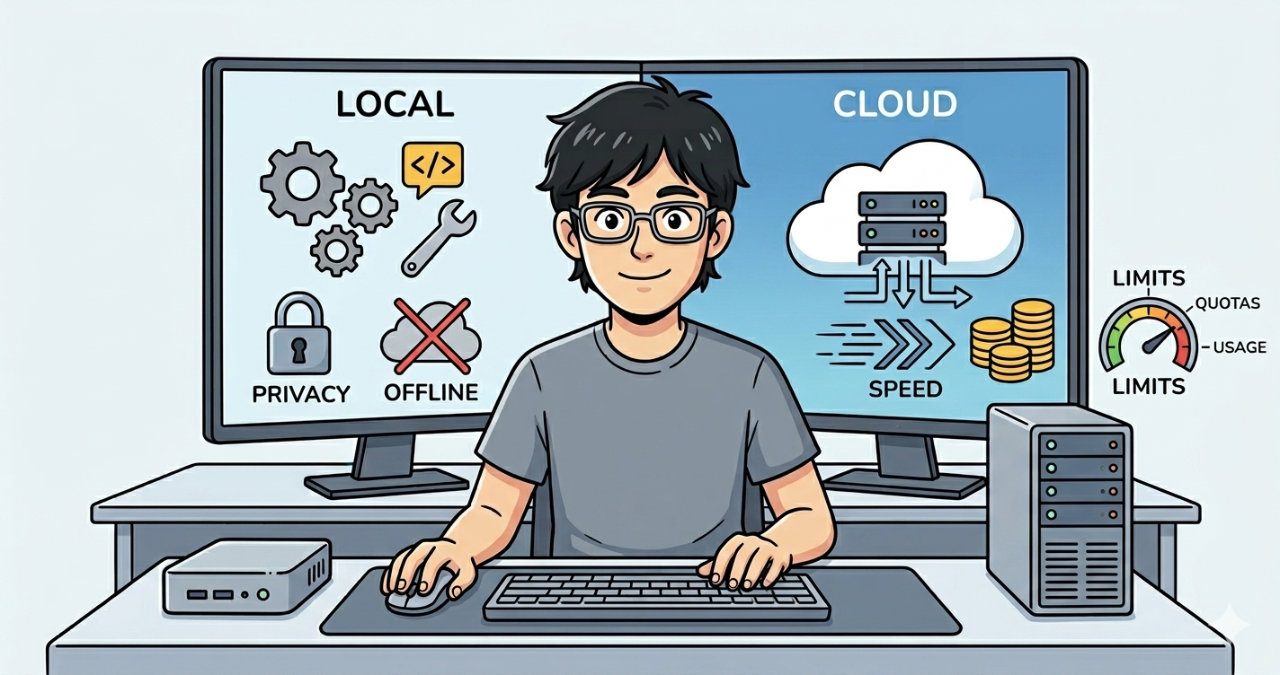

- ローカルで動かすのと何が違うのか

- クラウドを使う必要はあるのか

- 課金はどう考えればいいのか

といった点が気になってきます。

特に、これまで API ベースの AI を使ってきた場合、「どこまで無料で使えるのか」「従量課金との違いは何か」という点は判断に迷いやすい部分です。

この記事では、Ollama のローカル版とクラウド版の違いを整理しつつ、それぞれをどのように使い分けるのが現実的なのかをまとめます。

本サイトではローカル環境での運用を前提に検証を行っているため、その視点も踏まえて整理しています。

Ollama のローカル版とは

ローカル版は、自分の PC 上にモデルをダウンロードして実行する方式です。

Ollama では、モデル名を指定してコマンドを実行するだけで、ダウンロードと起動が一体になって行われます。

例えば、以下のように実行します。

ollama run qwen3.5:0.8b

初回はモデルのダウンロードが行われ、完了するとそのまま対話ができる状態になります。

以降はローカルに保存されたモデルが使われるため、再度ダウンロードする必要はありません。

基本的な使い方

この「ダウンロードしてそのまま使える」という流れが、Ollama の大きな特徴のひとつです。

実際のコマンドの使い方や終了方法については、以下で整理しています。

モデルの管理

また、モデルは個別にダウンロードして管理することもできます。

用途に応じてモデルを切り替えたり、あらかじめ取得しておく場合は、以下のコマンドを使います。

ollama pull モデル名このあたりの基本操作については、以下でまとめています。

特徴

- オフライン環境でも動作する

- データが外部に送信されない

- 実行速度や快適さはマシンスペックに依存する

ローカルで完結するという性質上、環境構築やモデル管理といった手間は発生しますが、その分コストを抑えつつ自由度の高い運用ができるのが特徴です。

Ollama のクラウド版とは

クラウド版は、Ollama が用意したサーバー上でモデルを実行する仕組みです。

ローカル版のようにモデルをダウンロードして手元で動かすのではなく、リクエストを送ることで結果を受け取る形になります。

そのため、実行に必要な計算処理は自分の PC ではなく、クラウド側の環境で行われます。

基本的な仕組み

クラウド版では、ローカルのようにモデルファイルを管理する必要はありません。

必要なモデルを選択し、リクエストを送るだけで利用できるため、環境構築の手間はほとんど発生しません。

この点は、Ollama を初めて触る場合や、一時的に試したい場合には扱いやすいポイントです。

実際の使い方(サインインやAPIキーの違い)については、以下でまとめています。

➡️ Ollama クラウド版の使い方(APIキー取得とサインインの違い)

ローカル版との違い

ローカル版との最も大きな違いは、「どこで処理が行われるか」です。

ローカル版では自分の PC のリソースを使って処理を行いますが、クラウド版では外部の GPU 環境が使われます。

そのため、

- 手元のスペックに依存しない

- 比較的大きなモデルでも動かせる

といったメリットがあります。

一方で、処理は外部環境で行われるため、ローカルのように完全に閉じた環境ではありません。

特徴

- 高性能な環境でモデルを実行できる

- セットアップがほぼ不要

- マシンスペックに依存しない

- 利用量に応じた制限がある

ローカル版と比べると手軽に高性能なモデルを扱える一方で、利用には一定の制約がある点が特徴です。

料金の考え方

クラウド版を理解する上で重要なのが、料金の仕組みです。

Ollama のクラウド機能は、一般的な AI API の課金体系とは少し異なる考え方になっています。

一般的な API 課金との違い

多くの AI サービスでは、トークン数やリクエスト数に応じた従量課金が採用されています。

使った分だけ料金が増えていくため、利用量が増えるほどコストも上がっていきます。

この仕組みは柔軟である一方で、使い方によっては想定以上のコストになる可能性もあります。

Ollama クラウドの仕組み

Ollama のクラウド機能は、完全な従量課金ではなく、使用量に応じた「上限付きの利用枠」として設計されています。

一定の範囲内であれば利用できますが、その上限に達すると制限がかかる仕組みです。

そのため、使いすぎた場合でも料金が増え続けるのではなく、「利用が制限される」という挙動になります。

制限の具体例

クラウド版には、いくつかの制限が設けられています。

- 一定時間ごとにリセットされる利用枠

- 週単位での利用上限

- 同時に実行できるモデル数の制限

これらは、クラウド側のリソースを安定して提供するための仕組みでもあります。

コストの考え方

この仕組みは、一般的な API 課金と比べると少し特徴的です。

使った分だけ無制限に課金されるのではなく、あらかじめ決められた範囲の中で利用する形になるため、コストの見通しは立てやすくなります。

一方で、上限に達した場合は一時的に利用できなくなるため、継続的な処理や高頻度の利用には注意が必要です。

ローカルとクラウドの違い

ここまでの内容を踏まえて、ローカル版とクラウド版の違いを整理します。

| ローカル版 | クラウド版 | |

|---|---|---|

| データの扱い | 手元で完結(外部に出ない) | 外部サーバーで処理 |

| パフォーマンス | マシンスペックに依存 | 安定した性能 |

| モデルの自由度 | 軽量〜中規模が中心 | 大規模モデルも利用可能 |

| コスト構造 | 基本無料(電力・PC代除く) | 上限付き利用枠 |

ローカルは環境に依存する一方で自由度が高く、クラウドは安定した性能を手軽に利用できるという違いがあります。

使い分けの考え方

ローカル版とクラウド版は、どちらか一方を選ぶというよりも、用途に応じて使い分けるのが現実的です。

ローカルを軸にする

日常的な利用や検証については、ローカル版を軸にするのが扱いやすい構成になります。

- 継続的なコストが発生しにくい

- データを手元で管理できる

- 環境をコントロールしやすい

といった点から、普段使いのベースとしてはローカルが適しています。

クラウドを補助的に使う

一方で、すべてをローカルで完結させるのが難しい場面もあります。

- ローカルでは動かせないサイズのモデルを試したい

- 一時的に高い性能が必要になる

- 環境構築を省略して試したい

こうしたケースでは、クラウド版を補助的に使うことで対応できます。

実際の運用イメージ

例えば、以下のような使い分けになります。

- 普段はローカルで軽量〜中規模モデルを使用する

- 重い処理や検証のみクラウドを利用する

このように役割を分けることで、コストと性能のバランスを取りやすくなります。

ローカルを軸にしつつ、必要に応じてクラウドを補助的に使うという構成は、現実的な運用のひとつといえます。

ローカルを軸にどう使い分けるか

Ollama はローカルとクラウドの両方でモデルを実行できる点が特徴ですが、それぞれの役割は大きく異なります。

ローカル版は、環境構築やモデル管理といった手間はあるものの、コストを抑えながら自由度の高い運用ができるのが特徴です。

一方でクラウド版は、手元のスペックに依存せず高性能なモデルを扱える反面、利用量に応じた制限があるため、使い方には一定の前提が必要になります。

どちらか一方を選ぶというよりも、用途に応じて使い分けることで、それぞれの特徴を活かすことができます。

まずはローカルで実際に動かしてみて、その上で必要に応じてクラウドを検討する、という流れが自然です。