Ollama のインストールが完了したら、次は実際に AI を動かしてみます。

ここでは難しいことはせず、「とりあえず1回動かす」ことをゴールにします。

ローカルLLM は最初の一歩が少しだけハードルに感じますが、このステップを超えると一気に理解が進みます。

ollama run とは何か

ollama run は、モデルを起動して AI と対話を始めるためのコマンドです。

このコマンド1つで、

- モデルのダウンロード(未取得の場合)

- モデルの起動

- チャット開始

までが一度に実行されます。

つまり、「AI を動かす入口」になるコマンドです。

実際にコマンドを実行する

まずはターミナル(Mac)または PowerShell(Windows)を開きます。

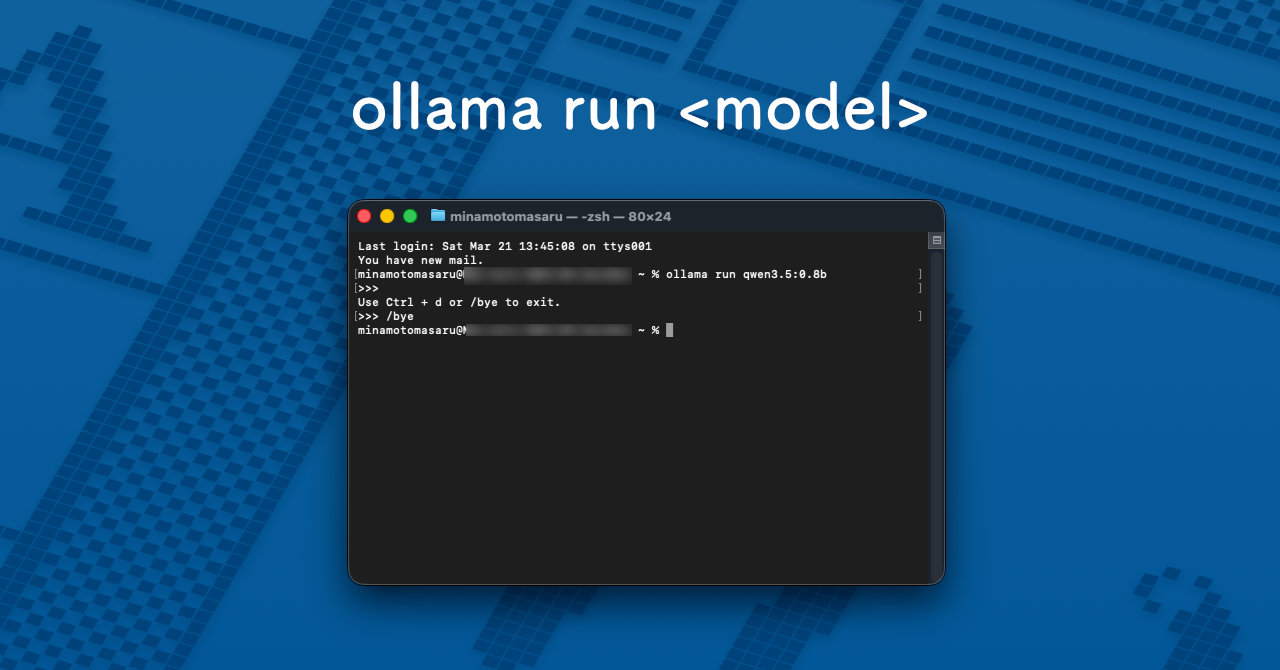

以下のコマンドを実行します。

ollama run qwen3.5:0.8bEnter を押すと、処理が始まります。

モデルのダウンロードについて

初回実行時は、モデルのダウンロードが始まります。

モデルは 数GB 〜 数十GB あるため、環境によっては 数分 〜 数十分 かかります。

ダウンロード中は進行状況が表示されます。

ここは少し待つだけでOKです。

※一度ダウンロードしたモデルは、次回以降すぐに起動できます。

AI と会話してみる

ダウンロードが完了すると、そのままチャットが開始されます。

試しに以下のように入力してみます。

こんにちは。簡単に自己紹介してください。すると、AI から応答が返ってきます。

これで、ローカル環境で AI が動いている状態です。

実際に触ってみると、「思ったより普通に使える」という感覚になると思います。

終了方法

チャットを終了するには、以下の方法があります。

/byeまたは

Ctrl + dこれで Ollama の実行を終了できます。

よくあるつまずき

・コマンドが認識されない

→ ターミナルを再起動する

・ダウンロードが遅い

→ モデルサイズが大きいため時間がかかる

・途中で止まる

→ もう一度コマンドを実行する

・文字が崩れる

→ ターミナルのフォント設定を変更する

次にやること

ここまでで「AIを動かす」ことはできました。

次は以下のステップに進むのがおすすめです。

・モデルを追加する

→ ollama pull の使い方 へ

・コマンドを理解する

→ Ollama のよく使うコマンドまとめ へ

まとめ

ollama run は、ローカルLLM を動かすための最初の一歩です。

このコマンド1つで、

・モデルの取得

・起動

・対話

までが一度に行えます。

まずは1回動かしてみる。

それだけで、ローカルLLM の理解は大きく進みます。