Ollama にはローカル環境で動かす方法とは別に、クラウド上でモデルを利用する仕組みがあります。

この記事では、

- Ollama クラウドのサインアップ

- サインイン(CLI連携)

- APIキーの取得

- 認証方法の違い

までを、実際の操作ベースで整理します。

ローカル版との違いや使い分けについては、以下の記事でまとめています。

➡️ Ollama ローカル版とクラウド版の違い

Ollama クラウド版とは

Ollama クラウド版は、自分の PC ではなく外部の環境でモデルを実行する仕組みです。

ローカル版と比較すると、

- 環境構築なしで使える

- 大きいモデルでも動かせる

というメリットがあります。

一方で、

- 利用量に応じた制限がある

- 同時実行数に制限がある

といったクラウド特有の制約もあります。

「無料で使える=無制限」ではない点は注意が必要です。

サインアップ & サインイン

まずは Ollama の 公式サイト からサインアップを行います。

- アカウント作成

- サインイン(ログイン)

- ダッシュボードの表示

この時点で、クラウド版を利用する準備が整います。

Ollama クラウドの認証方法

Ollama クラウドには、利用方法が2つあります。

CLI から使う場合(サインイン方式)

ターミナルで以下を実行します。

ollama signin

ollama signin ( Device Key を発行 ) したところサングラスかけてる・・・可愛い・・・

この方法では、

- 自動的に Device Key が発行される

- APIキーの設定は不要

そのまま以下のようにクラウドモデルを実行できます。

ollama pull gpt-oss:120b-cloudローカル環境の延長として使えるのが特徴です。

API として使う場合(APIキー方式)

一方で、外部 AI ツールやアプリケーションなどから利用する場合は、APIキーを使用します。

基本的な流れは以下です。

- 設定画面に移動

- APIキーを発行

- 環境変数やアプリ内で APIキーを設定

export OLLAMA_API_KEY=your_api_keyこの方法では、ollama.com をリモートAPI として利用します。

Device Keys の位置づけ

Device Keys は、CLI でサインインした際に自動的に作成されるキーです。

通常は手動で設定する必要はなく、ローカル環境とクラウドの紐付けに内部的に使用されます。

実際にリクエストしてみる

Ollama クラウドは、いくつかの方法でモデルを呼び出すことができます。

ここではまず、最もシンプルな CLI から試してみます。

CLI から実行する

ターミナルでサインインします。

ollama signinサインイン後、そのままクラウドモデルを実行できます。

ollama run gpt-oss:120b-cloud

ローカルモデルと同じようにコマンドを実行するだけで、クラウド上のモデルが呼び出されます。

APIキーの設定は不要で、「サインインするだけ」で使えるのが特徴です。

まずはこの方法で、「クラウドモデルが動く」ことを確認しておくと理解しやすくなります。

API から実行する(外部ツール連携)

CLI 以外にも、APIキーを使うことで、

- n8n

- Claude Code

- Open WebUI

などの AI ツール(アプリケーション)からモデルを呼び出すことができます。

実際に使ってみた使用量の記録

Ollama クラウドの使用量は、一般的な API のような「トークン従量課金」ではなく、使用量ベースで管理されています。

そのため、「○○トークンで上限」という明確な基準はありません。

ここでは、実際にリクエストした結果をもとに使用量の感覚を確認します。

実行内容

- 使用モデル:gemini-3-flash-preview

- 使用トークン:約2251 tokens

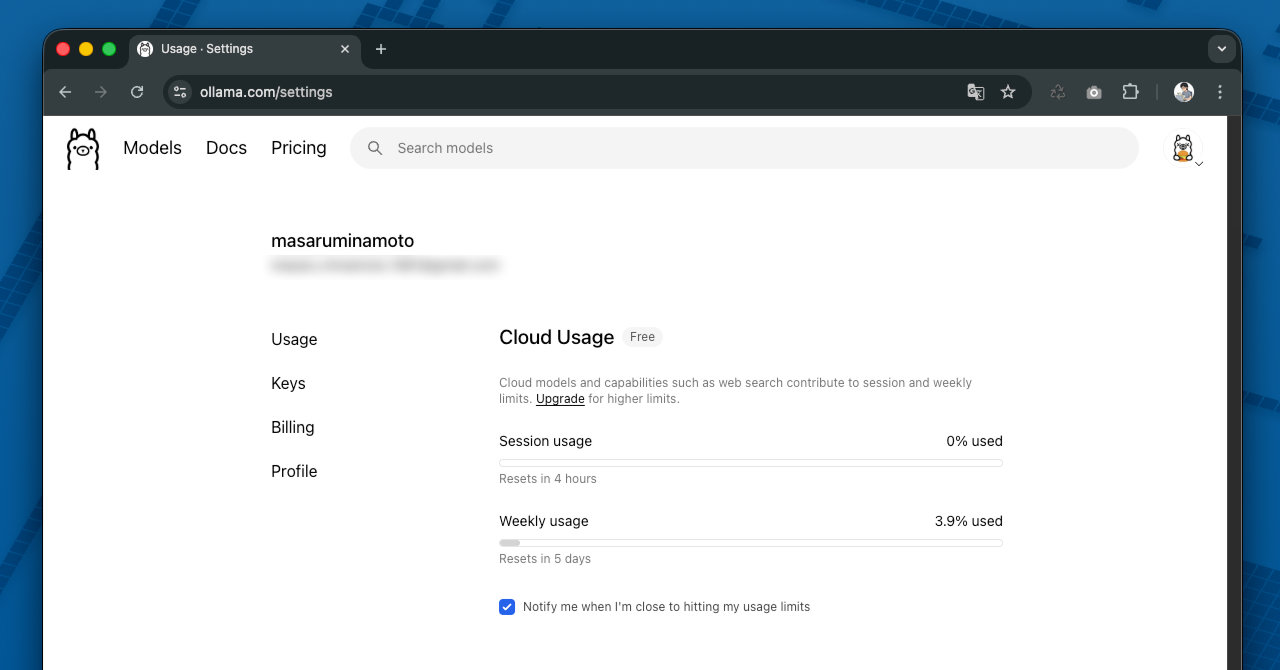

管理画面の表示

- Session usage:2%

- Weekly usage:0.8%

使用量の見え方

今回の結果から見ると、

- 数千トークンで数%消費される

という感覚になります。

ただしこれはあくまで一例であり、

- モデルの種類

- 出力の長さ

- 処理時間

によって消費量は変わるだろうと思われます。

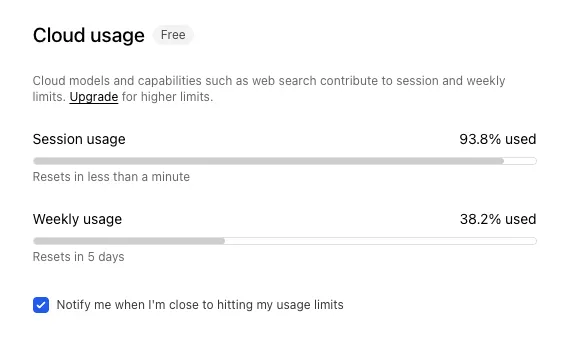

実際に数日使っていて分かりやすかったのが、Ollama クラウド Free プランでは「Session usage」と「Weekly usage」が別々に管理されていることです。

最初は Session usage の方だけ見ていると、かなり早く上限に近づくため驚くかもしれません。

実際、gemma4:31b-cloud を使っていると短時間で 90% を超えることがあり、そのタイミングで以下のようなメール通知も届きました。

You’ve reached 90% of your session limit for your free plan

ただ、この Session usage は一定時間で自動リセットされます。

そのため、表示上はほぼ上限に見えても、少し待つと再び利用できます。

一方で、Weekly usage は1週間単位で積み上がるため、こちらの方が実際の利用可能量に近い感覚です。

短時間の検証では Session usage が先に増えますが、継続して使う場合は Weekly usage を見ながら調整する方が現実的だと感じました。

20〜30B クラスをクラウドで使うという選択肢

ここは少し試してみて印象が変わったポイントです。

今回の検証では gemini-3-flash-preview を例にしていますが、他にも

🧠 gpt-oss:20b-cloud

🧠 gemma4:31b-cloud

といった、いわゆる「中〜やや大きめ」のモデルもいくつか試しています。

結論としては、このクラスでも使用量の増え方はかなり緩やかな印象でした。

体感としては、

Session usage:数%程度

Weekly usage:1%未満〜数%

くらいに収まるケースが多く、「思っていたより減らない」という感覚です。

もちろん、

- 出力の長さ

- リクエスト回数

- 処理内容(単純なチャットか、重い推論か)

によって変わるため一概には言えませんが、「高性能モデル=すぐ上限に達する」というほど単純なものではなさそうです。

そのため使い方としては、

- ローカル → 日常的な処理

- クラウド(20〜30B) → 少し重い処理や検証

というだけでなく、「クラウドでもこのクラスを普通に使う」という選択肢も現実的にありだと感じました。

特に、

- ローカルだと重い

- でも超巨大モデルまでは不要

という場面では、このあたりのモデルがちょうどいいバランスになります。

まだ試行段階ではありますが、今後はこのクラスをもう少し積極的に使っていくか検討しています。

使用量の考え方

重要なのは、

- トークン単位で厳密に制御されているわけではない

- しかし「使った分だけ減っていく」感覚はある

という点です。

そのため、

- 管理画面の使用率

- 実際の使用ペース

を見ながら、あとどれくらい使えるかを判断していく形になります。

Freeプランの現実的な使い方

今回の使用感から考えると、

- 軽い検証や試し打ち → 十分可能

- 継続的な大量処理 → 制限に達しやすい

というバランスになります。

完全な使い放題ではありませんが、「試す」「動作確認する」といった用途には十分使える範囲です。

ローカルとクラウドはどう使い分けるか

Ollama クラウドは便利ですが、常用するには制限があります。

現実的な使い分けとしては、

- 日常的な作業 → ローカル

- 重い処理や検証 → クラウド

という形になります。

特にローカル環境が整っている場合は、クラウドは「補助的に使う」方がバランスが良いです。

まとめ

Ollama クラウド版は、

- サインインするだけで使える方法(CLI)

- APIキーで外部から使う方法(API)

の2つの使い方があります。

高性能なモデルを簡単に試せる一方で、

- 使用量の制限がある

という点は理解しておく必要があります。

ローカル版と組み合わせることで、用途に応じた柔軟な運用が可能になります。