ローカルLLM を触っていると、必ず出てくるのが「どのモデルを使えばいいのか」という問題です。

ネット上にはおすすめモデルの情報も多いですが、

- 環境によって変わる

- 用途によって変わる

- 実際に使うと印象が変わる

というのが正直なところです。

この記事では、「一般的なおすすめ」ではなく、

- Mac mini M4( 32GB メモリ / 1TB SSD )

- Ollama 0.19.0

という環境で、実際に試して今も使っているモデルをまとめます。

いわゆるランキングではなく、「実験ログ」に近い形です。

これからモデルを選ぶときの参考になればと思います。

使っている環境

今回の検証環境は以下です。

| CPU | Apple M4 |

| メモリ | 32GB |

| ストレージ | 1TB SSD |

| OS | macOS Tahoe 26.3.1 |

| Ollama | 0.19.0 |

この構成であれば、20B クラスのモデルも現実的に動かせます。

ただし重要なのは、「動くかどうか」ではなく、

- 快適に使えるか

- 他の作業と両立できるか

という点です。

ローカルLLM はメモリを大きく消費するため、常に余裕を意識する必要があります。

モデル選びの前提

最初に結論っぽい話をしておくと、モデルは1つに絞らない方がいいです。

用途によって向き不向きがあるため、

- 重いけど精度が高いモデル

- 軽くてすぐ試せるモデル

- 特化型モデル

という形で分けた方が使いやすくなります。

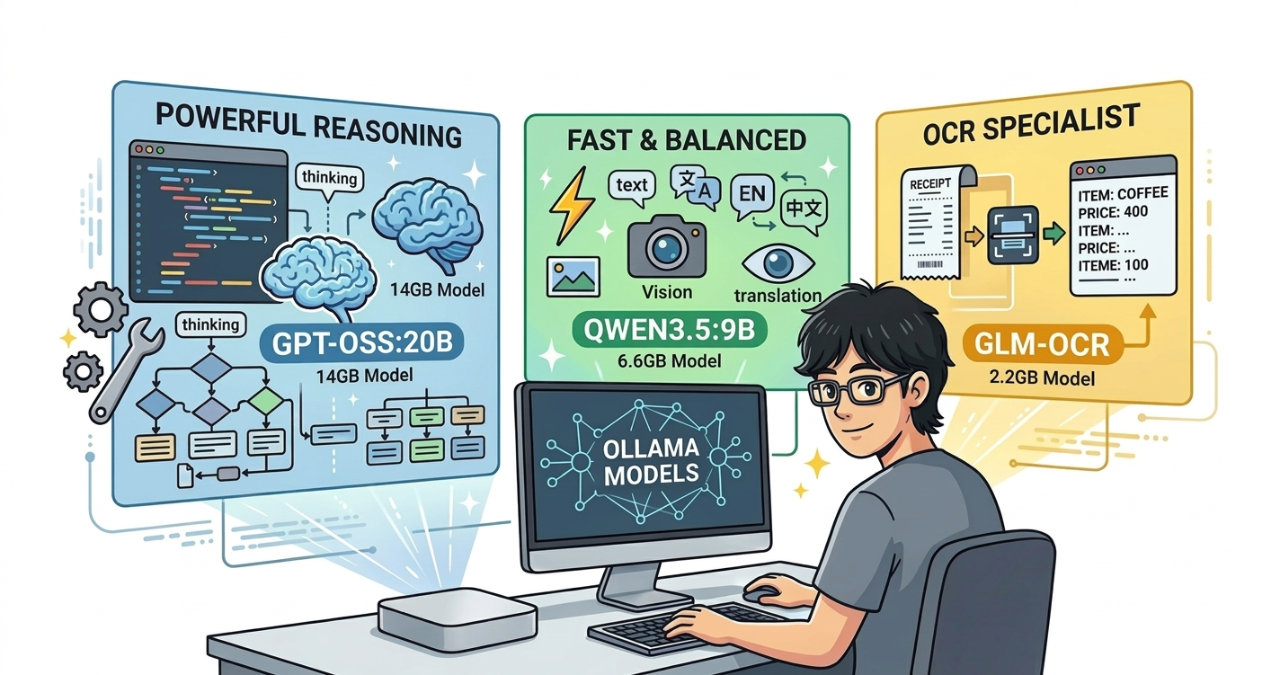

この前提で、僕は現在 3つのモデルをメインに使っています。

実際に使っているモデル

ここからは、実際に触って「気に入っているモデル」だけを紹介します。

gpt-oss:20b(モデルサイズ:約14GB)

まず1つ目が gpt-oss:20b です。

いわゆる「とりあえずこれを使う」ポジションのモデルです。

特徴としては、

- 回答の安定感が高い

- コード生成や説明が無難に強い

- tools / thinking に対応

といったバランス型です。

実際の体感としては、ローカルLLM でもここまでできるのかというラインを確認するのにちょうどいいモデルです。

32GB 環境であれば、単体運用は問題なし。

ただし、他のアプリを開きすぎるとメモリを圧迫します。

qwen3.5:9b(モデルサイズ:約6.6GB)

次に、日常的によく触っているのが qwen3.5:9b です。

これはかなりバランスが良く、

- 軽い

- 速い

- そこそこ賢い

という扱いやすいモデルです。

特に良いと感じているのは、

- 日本語が比較的自然

- コード生成も可能

- tools / thinking / vision に対応

という点です。

「とりあえずこれでいいか」と思える場面が多く、結果的に使用頻度は高くなっています。

重いモデルを常用するより、このクラスを回す方が快適です。

glm-ocr(モデルサイズ:約2.2GB)

3つ目は少し方向性が違って、OCR 特化の glm-ocr です。

これはチャット用途ではなく、

- レシート読み取り

- 画像からテキスト抽出

といった用途で使っています。

特に n8n と組み合わせると、画像 → テキスト化 → データ整理、という流れを自動化できます。

軽量なので常時置いておけるのもメリットです。

一方で注意点として、半角カナの認識に対応していないというデメリットがあります。

レシートや店舗データでは半角カナが使われるケースも多いため、

- 変換処理を挟む

- 後処理で補正する

といった対応が必要になる場面もあります。

こういう「特化モデル」は1つあると便利ですが、完全に任せきりにするというよりは、後処理込みで使う前提になります。

qwen3.5:35b-a3b-coding-nvfp4(モデルサイズ:約22GB)

qwen 系の中でもコーディング寄りのモデルで、Claude Code と組み合わせて使ってみたところ、かなり実用的でした。

正直なところ、35B クラスはこの環境だと厳しいと思っていたのですが、NVFP4 形式の影響もあって現実的に動作します。

実際に使ってみた印象としては、

- コード生成の精度が高い

- 修正指示に対する追従性が良い

- 文脈を踏まえた出力が安定している

といった特徴があります。

特に Claude Code と組み合わせた場合、

- 指示 → 実装

- 修正 → 再生成

の流れがスムーズで、「ローカルでもここまでできるのか」という感触があります。

一方で注意点として、

- メモリの余裕はほぼない

- 他アプリとの同時起動は厳しい

- 長時間運用は少し気を使う

といった制約はあります。

そのため、常用というよりは

- しっかりコードを書かせたいとき

- 精度を優先したいとき

に使うポジションになっています。

「クラウド級」とまでは言えませんが、ローカル環境でここまで安定して動くのはかなり現実的なラインに来ていると感じています。

使い分けの考え方

今のところ、僕の中ではこんな感じで使い分けています。

gpt-oss:20b

→ 精度重視(しっかり回答がほしいとき)

qwen3.5:9b

→ 普段使い(まずはこれ)

glm-ocr

→ OCR / 自動化用

qwen3.5:35b-a3b-coding-nvfp4

→ Claude Code 用

重要なのは、最適な1つを探すことではなく、用途ごとに分けることです。

Ollama はモデルの切り替えが簡単なので、

- 試す

- 合わなければ変える

を前提にした方がうまくいきます。

まとめ

Mac mini M4(32GB)環境で、現在よく使っているモデルはこの4つです。

- gpt-oss:20b(高精度・汎用)

- qwen3.5:9b(軽量・バランス)

- glm-ocr(OCR特化)

- qwen3.5:35b-a3b-coding-nvfp4(Claude Code)

この構成にしてから、

- 重すぎて使えない

- 軽いけど精度が足りない

といったストレスはかなり減りました。

ローカルLLM は、

- モデル選び

- メモリ管理

- 使い分け

で体験が大きく変わります。

最初から正解を探すよりも、いくつか試して残すというやり方の方が、結果的に早いです。

今後も、Ollama のアップデートや新モデルに合わせて、このあたりは随時見直していきます。