「ChatGPT のような AI を、自社の機密情報で使いたい」

「Ollama ならデータ漏洩しないと聞いたけど、本当に大丈夫?」

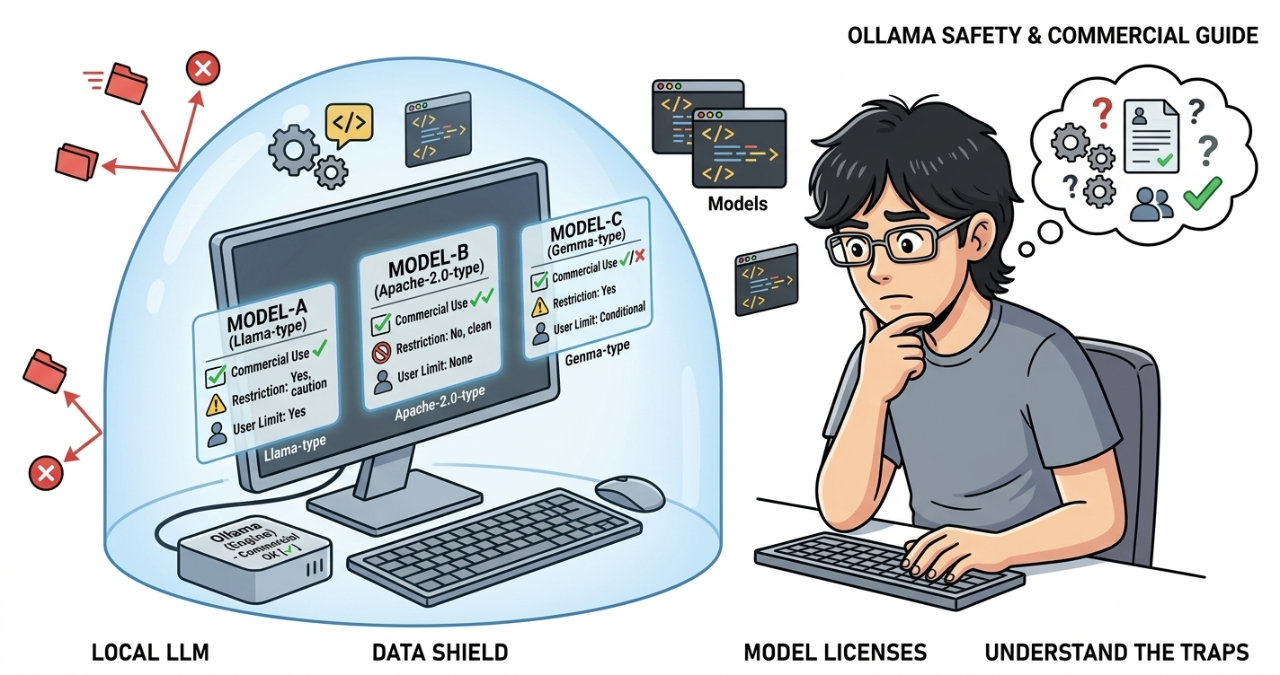

ローカルLLM に興味を持ったとき、必ず出てくるのがこの2つの不安です。

- 安全性・プライバシー(データは外に出ないのか)

- ライセンス(仕事で使って問題ないのか)

Ollama は非常に強力なツールですが、この2点を曖昧にしたまま使うと、逆にリスクになります。

この記事では、

- Ollama のプライバシーの仕組み

- 安全だと言われる理由

- 見落としやすいライセンスの罠

を、実際に使っている前提で整理します。

Ollama はなぜ「安全・プライバシーに強い」と言われるのか

結論から言うと、Ollama はクラウド型 AI と比べて「プライバシーを保ちやすい構造」です。

入力データがローカル環境で完結しやすいため、外部サーバーへ情報を送信するクラウド型 AI よりも、情報管理を自分でコントロールしやすい特徴があります。

ただし「完全に安全」ではなく、「仕組み的にリスクが低い」という理解が正確です。

データは PC 内で完結する

Ollama の最大の特徴は「ローカル完結」です。

- 入力したプロンプト

- ソースコード

- 機密情報

これらは外部サーバーに送信されず、PC 内で処理されます。

クラウド型 AI( ChatGPT・Gemini・Claude など)の場合は、ユーザー入力 → インターネット → 外部サーバーという流れになりますが、Ollama はこれがありません。

オフラインでも動作する

Ollama は、モデルのダウンロード後はオフラインでも動きます。

つまり、

- 通信の盗聴リスクがない

- 外部送信の経路自体が存在しない

という状態になります。

この点が「機密情報に強い」と言われる理由です。

ただし「 PC 自体のセキュリティ」は別問題

ここはかなり重要です。

Ollama が安全でも、PC が安全とは限りません。

例えば、

- マルウェア感染

- リモートアクセスの設定ミス

- 社内ネットワークの穴

こういった問題があれば、普通に情報は漏れます。

Ollama は「外に送らない」だけであって、「守ってくれる」わけではありません。

ここを誤解しないことが重要です。

Ollama とモデルは別物

ここが一番つまずきやすいポイントです。

Ollama を使うときは、必ずこの2つを分けて考える必要があります。

- Ollama(実行環境)

- モデル(実際に動くAI)

Ollama は「エンジン」

Ollama は、AI モデルを動かすためのツールです。

いわば、

エンジン(動かす仕組み)

の役割です。

この部分は基本的に自由度が高く、商用利用の制限はほぼ問題になりません。

モデルは「燃料」

実際に文章を生成しているのは、ダウンロードしたモデルです。

- Llama 3

- Gemma

- Mistral

など

こちらが、

燃料(知能)

にあたります。

そして、重要なのはここです。

商用利用の可否は、この「モデル側」で決まります。

よくある誤解

かなり多いのがこれです。

「Ollama で動く = 商用利用OK」

これは完全に間違いです。

正しくは、

「そのモデルのライセンス次第」

です。

モデルごとに違うライセンスの考え方

モデルにはそれぞれルールがあります。

ざっくりした傾向としては以下の通りです。

Llama 系(Meta)

基本的に Meta 独自ライセンスで提供されています。

- 商用利用は可能なケースが多い

- ただし Apache 2.0 のような完全なオープンライセンスではない

- 利用規模や用途に関する制限がある場合がある

同じ「Llama」シリーズでもバージョンごとに条件が異なるため、利用前に公式のライセンス確認が必要です。

Gemma 系(Google DeepMind)

モデルごとにライセンスが異なるため注意が必要です。

- 初期の Gemma モデル

→ Google 独自ライセンス(商用利用可だが条件あり) - Gemma 4

→ Apache 2.0 ライセンス(比較的自由に利用可能)

同じ「Gemma」シリーズでもライセンスは固定ではなく、今後のモデルで変更される可能性もあります。

利用前に、対象モデルの公式ドキュメント(Model Card)を確認することが前提です。

Apache 2.0 系モデル

- かなり自由に使える

- 商用利用しやすい

迷ったら Apache 2.0 系モデルから試すのが安全です。

商用利用する前に確認すべき3つ

実際に仕事で使うなら、この3つだけは必ずチェックした方がいいです。

1. 商用利用が許可されているか

Model Card(モデルの説明ページ)で、

Commercial use allowed

等と明記されているか確認します。

2. ユーザー数などの制限がないか

モデルによっては、

- 一定規模以上で契約が必要

- 利用条件が変わる

といったケースがあります。

3. 禁止事項に触れていないか

例えば、

- 医療用途 NG

- 特定の生成物 NG

など、細かい制約がある場合があります。

ここを見ずに使うのが一番危険です。

よくある勘違い

実際に触っていると、以下のような誤解が出やすいです。

- ローカルだから完全に安全

- 無料だから自由に使える

- 動いたから問題ない

どれも微妙にズレています。

正しくは、

- 外に出ないが、環境次第でリスクはある

- 無料でもライセンス制約はある

- 動作と合法性は別

です。

まとめ|安全に使うための前提

Ollama は、正しく使えばかなり強力な基盤です。

特に重要なのはこの2点です。

- データはローカルで完結する(安全性・プライバシー面のメリット)

- モデルごとのライセンスを確認する(法的な前提)

この2つを押さえておけば、

「実験用ツール」から

「実用環境」

に一気に変わります。

ローカルLLM は便利ですが、「理解して使う」かどうかで価値が大きく変わります。

まずは今使っているモデルのライセンスを一度確認してみるのがおすすめです。