AI 最前線ウォッチ

AI 最前線ウォッチ Ollama 0.23 リリース:Claude Desktop で Ollama Cloud のモデルが利用可能に

Ollama 0.23 のリリースにより、Claude Desktop 上で Ollama Cloud のモデルを利用できるようになりました。これにより、Claude Code や Claude Cowork を通じて、さまざまな AI モ...

AI 最前線ウォッチ

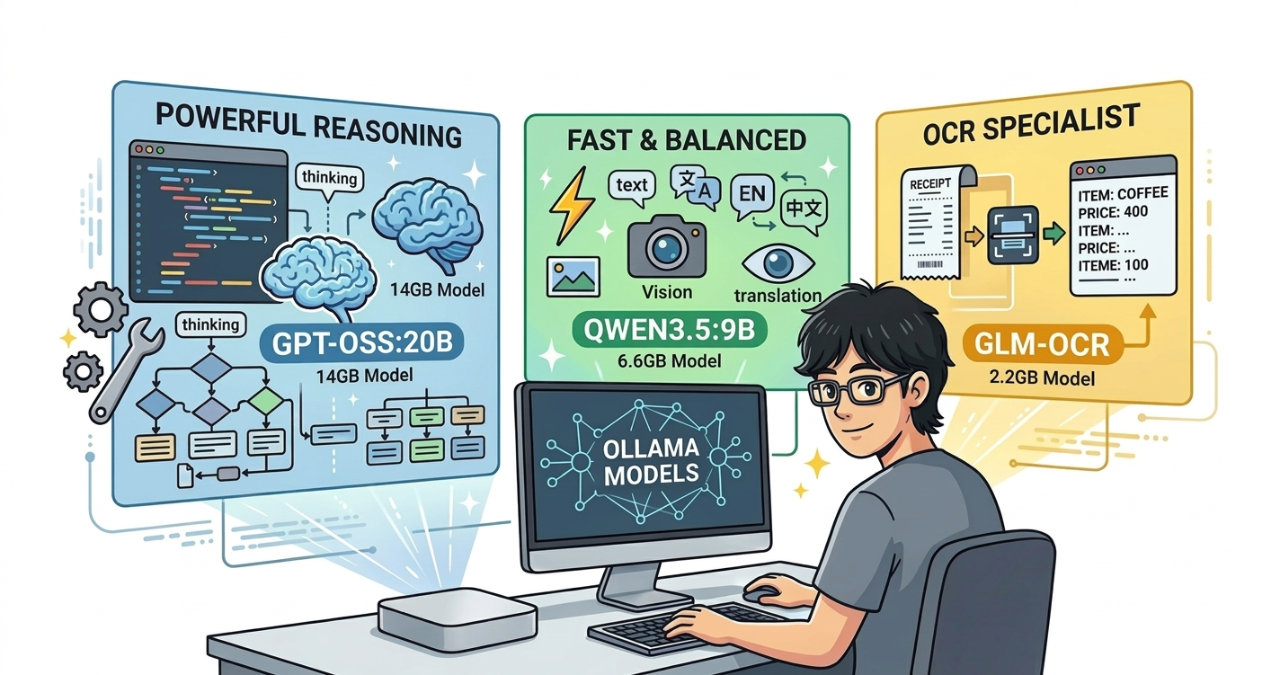

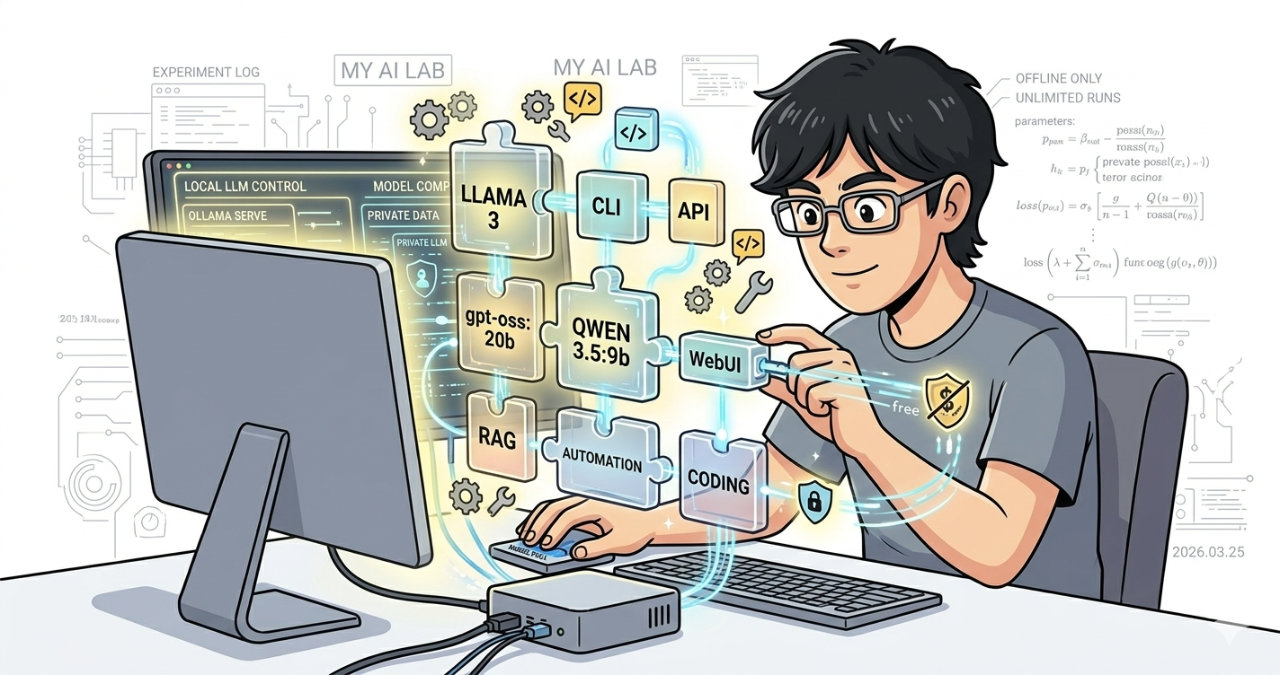

AI 最前線ウォッチ  無料で AI を使う

無料で AI を使う  AI 最前線ウォッチ

AI 最前線ウォッチ  AI 最前線ウォッチ

AI 最前線ウォッチ  AI 最前線ウォッチ

AI 最前線ウォッチ  AI 最前線ウォッチ

AI 最前線ウォッチ  無料で AI を使う

無料で AI を使う  AI への投資

AI への投資  無料で AI を使う

無料で AI を使う  無料で AI を使う

無料で AI を使う  無料で AI を使う

無料で AI を使う  無料で AI を使う

無料で AI を使う